Il caso Getty vs Stability AI e i limiti del copyright nell’era dell’IA generativa

La High Court britannica respinge le accuse di copia contro Stability AI, lasciando aperto il nodo dell’uso di opere protette per addestrare l’IA

L’Alta Corte di Giustizia del Regno Unito ha pubblicato una decisione molto discussa sul caso che ha visto opposti “Getty Images” e “Stability AI”, una delle battaglie più emblematiche sul rapporto tra modelli generativi e diritti di proprietà intellettuale. Getty rappresenta una delle più importanti banche dati di immagini online protette da copyright e, nel 2023, ha mosso l’azione contro “Stable Diffusion” di Stability perché avrebbe violato il suo marchio e materiale protetto dal diritto d’autore. La prova? Alcune immagini rigenerate hanno riprodotto la tipica filigrana contenuta nelle immagini di Getty.

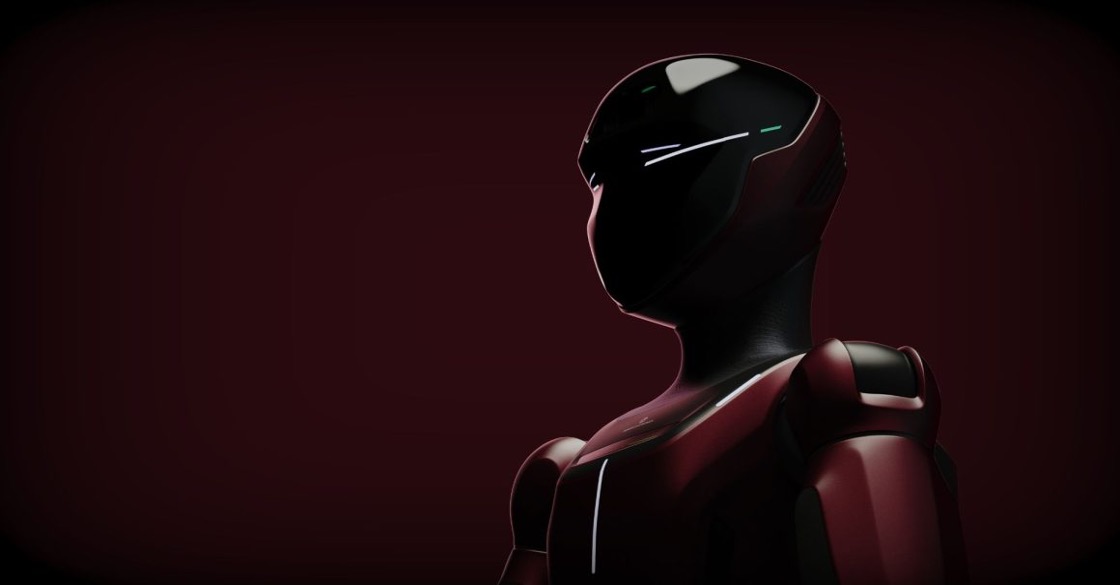

La Corte ha riconosciuto che il modello Stable Diffusion può averla riprodotta, ma la decisione si ferma qui: secondo la giudice, Joanna Smith, non è stata dimostrata alcuna violazione primaria sul territorio britannico. Ancora più rilevante: per la giudice, un modello di IA che non memorizza né riproduce copie delle opere originali non può essere considerato una “copia illecita” ai sensi del Copyright, designs and patents act del Regno Unito.

Il risultato è una vittoria processuale per Stability AI ma nessun chiarimento sul tema centrale della contesa: si possono addestrare modelli di IA su opere protette? Come si tutela davvero un dataset? Chi è responsabile quando l’output “sfiora” il copyright?

In altre parole: se l’output non è una copia, dov’è il danno? Domanda legittima, ma che lascia aperto tutto ciò che accade prima dell’output: l’uso massivo di opere protette per addestrare l’IA.

La tecnologia corre, il diritto rincorre. Per questo alcune aziende stanno cominciando a ragionare oltre il diritto tradizionale approdando a strumenti come, ad esempio, la blockchain per tracciare le opere, o NFT per la certificazione delle stesse.

Seguiamo con attenzione l’evoluzione di questi casi perché la proprietà intellettuale oggi più che mai è al centro dell’innovazione. Le tecnologie cambiano, ma il bisogno di proteggere il valore creativo rimane. E cresce.